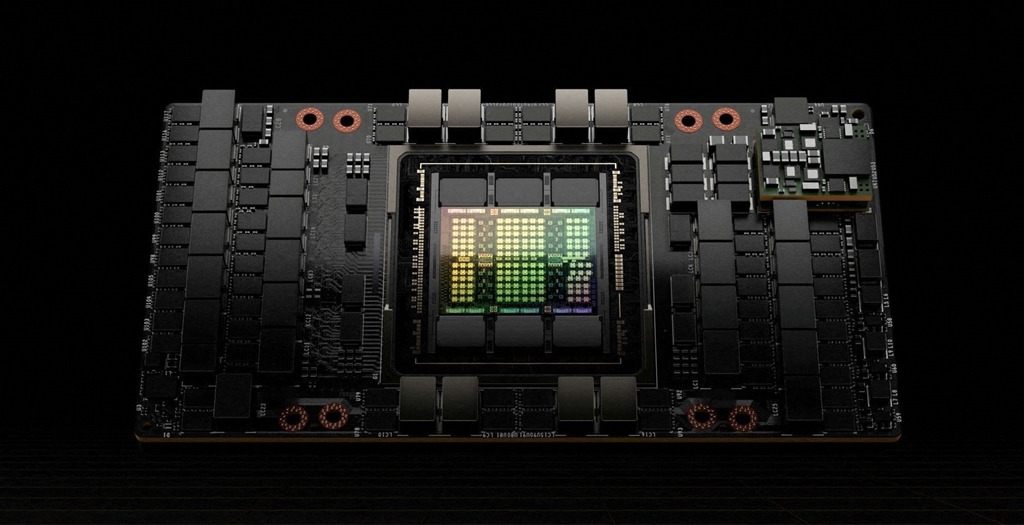

NVIDIA H100 Tensor core GPU NVIDIA H100 NVL 94GB PCIe

NVIDIA® H100 NVL は、最新のGPUアーキテクチャ「Hopper」を採用し、大容量94GB Bandwidth7.8TB/sの高性能HBM3メモリ、第4世代のTensorコア、前世代となるNVIDIA A100 GPUの約1.5倍にあたる800億個のトランジスタが搭載されています。

【レンタルでの導入も可能】

GPUレンタルのメリットとして初期投資の削減が可能になります。

高性能なGPUを購入する必要がなく、必要なときだけレンタルできるため、コスト効率をご検討される方にお勧めです。ご希望の場合、見積もり画面から選択できます。

- Hopper

- PCIe 5.0

- HBM3

- 94GB

- [FP64]30TFLOPS

- [FP32]60TFLOPS

- FP16/ FP8演算性能

- 3年保証